иҙқжһ—еҺ„е§ҶзӣҳеёҰжҠҖжңҜй—ӘиҖҖиөӣеңәпјҢе…ій”®иЎЁзҺ°еҠ©зҗғйҳҹиҝһиҺ·иғңеҲ©вҖ”вҖ”иҝҷиҜқзңҹдёҚжҳҜеҗ№зҡ„гҖӮ2024е№ҙ1жңҲеҜ№йҳөз“ҰдјҰиҘҝдәҡйӮЈеңәпјҢд»–дёҠеҚҠеңә第37еҲҶй’ҹеңЁдёӯеңәиғҢиә«жҺҘзҗғпјҢдёҖдёӘжҖҘеҒңеҸҳеҗ‘з”©ејҖдёӨдәәпјҢжҺҘзқҖиҝһз»ӯиё©еҚ•иҪҰзӘҒе…ҘзҰҒеҢәпјҢиҷҪ然没иҝӣзҗғпјҢдҪҶеҲ¶йҖ дәҶеҜ№ж–№еҗҺеҚ«зҠҜ规пјҢдёәзҡҮ马иөўеҫ—е…ій”®д»»ж„ҸзҗғгҖӮSofascoreиөӣеҗҺз»ҷд»–жү“дәҶ8.2еҲҶпјҢе…ЁеңәжңҖй«ҳгҖӮиҝҷе“Ҙ们е„ҝеҠ зӣҹзҡҮ马дёҚеҲ°еҚҠе№ҙпјҢе·Із»ҸжҲҗдәҶе®үеҲҮжҙӣи’ӮжҲҳжңҜйҮҢжңҖй”ӢеҲ©зҡ„йӮЈжҠҠеҲҖгҖӮжӣҙеҲ«жҸҗд»–еңЁ2023-24иөӣеӯЈиҘҝз”ІеүҚ19иҪ®иҙЎзҢ®6зҗғ3еҠ©ж”»пјҢе…¶дёӯ5дёӘиҝӣзҗғжқҘиҮӘзҰҒеҢәеҶ…жҺҘзӣҳеёҰеҗҺзҡ„е°„й—ЁпјҢж•°жҚ®иҜҙиҜқпјҢзЎ¬ж ёгҖӮ

зӣҳеёҰ+жҺЁиҝӣпјҢеҸҢжқҖж•ҲзҺҮ

иҙқжһ—еҺ„е§Ҷзҡ„зӣҳеёҰдёҚжҳҜиҠұжһ¶еӯҗпјҢжҳҜе®һжү“е®һиғҪж’•ејҖйҳІзәҝзҡ„жӯҰеҷЁгҖӮTransfermarktж•°жҚ®жҳҫзӨәпјҢд»–еңЁ2023-24иөӣеӯЈиҘҝз”ІеңәеқҮжҲҗеҠҹиҝҮдәә2.1ж¬ЎпјҢжҲҗеҠҹзҺҮй«ҳиҫҫ68%пјҢеңЁдёӯеңәзҗғе‘ҳйҮҢжҺ’第дёҖгҖӮжӣҙзӢ зҡ„жҳҜд»–зҡ„жҺЁиҝӣиғҪеҠӣвҖ”вҖ”жҜҸ90еҲҶй’ҹеёҰзҗғжҺЁиҝӣи·қзҰ»иҫҫ187зұіпјҢжҜ”зҪ—еҫ·йҮҢй«ҳиҝ‘40зұіпјҲWhoScoredж•°жҚ®пјүгҖӮиҝҷз§ҚвҖңд»ҺдёӯеңәдёҖи·ҜеёҰеҲ°зҰҒеҢәвҖқзҡ„жү“жі•пјҢи®©зҡҮ马еҸҚеҮ»йҖҹеәҰзӣҙжҺҘжӢүж»ЎгҖӮжҜ”еҰӮ12жңҲеҜ№йӮЈдёҚеӢ’ж–Ҝзҡ„欧еҶ е°Ҹз»„иөӣпјҢ他第63еҲҶй’ҹеңЁжң¬ж–№еҚҠеңәж–ӯзҗғеҗҺиҝһз»ӯеҸҳеҗ‘жҺЁиҝӣ60зұіпјҢжңҖеҗҺеҲҶиҫ№еҠ©ж”»з»ҙе°јдҝ®ж–Ҝз ҙй—ЁпјҢж•ҙеҘ—еҠЁдҪңдёҖж°”е‘өжҲҗпјҢиҝһи§ЈиҜҙйғҪе–ҠвҖңиҝҷе“ӘжҳҜдёӯеңәпјҢиҝҷжҳҜеҲәе®ўпјҒвҖқ

дҪ“зі»йҖӮй…ҚпјҢдҪҚзҪ®и§Јж”ҫ

е®үеҲҮжҙӣи’ӮжҠҠд»–ж”ҫеңЁдјӘд№қеҸ·дҪҚзҪ®пјҢеҪ»еә•йҮҠж”ҫдәҶд»–зҡ„иҝӣж”»еӨ©иөӢгҖӮиҝҮеҺ»еңЁеӨҡзү№и’ҷеҫ·пјҢиҙқжһ—еҺ„е§ҶжӣҙеӨҡиёў8еҸ·дҪҚпјҢиҙҹиҙЈиЎ”жҺҘе’ҢиҰҶзӣ–пјӣеҲ°дәҶзҡҮ马пјҢз”ұдәҺжң¬жіҪ马зҰ»йҳҹгҖҒдёӯй”ӢдҪҚзҪ®з©әзјәпјҢд»–иў«жҺЁеҲ°жӣҙйқ еүҚзҡ„дҪҚзҪ®пјҢз”ҡиҮіз»Ҹеёёеӣһж’ӨжӢҝзҗғеҶҚдәҢж¬ЎеүҚжҸ’гҖӮиҝҷз§ҚвҖңиҮӘз”ұдәәвҖқи§’иүІи®©д»–иғҪйў‘з№Ғиҝӣе…Ҙе°„зЁӢгҖӮSofascoreз»ҹи®ЎжҳҫзӨәпјҢд»–жң¬иөӣеӯЈеңЁеҜ№ж–№зҰҒеҢәеҶ…и§Ұзҗғж¬Ўж•°иҫҫеңәеқҮ4.3ж¬ЎпјҢиҝңи¶…дёҠиөӣеӯЈеңЁеҫ·з”Ізҡ„1.9ж¬ЎгҖӮиҖҢдё”д»–е°„й—ЁиҪ¬еҢ–зҺҮй«ҳиҫҫ22.7%пјҲ6зҗғ/26ж¬Ўе°„жӯЈпјүпјҢж•ҲзҺҮе ӘжҜ”йЎ¶зә§еүҚй”ӢгҖӮйҡҫжҖӘе®үеё…иөӣеҗҺзӣҙиЁҖпјҡвҖңд»–дёҚжҳҜжӣҝд»Ји°ҒпјҢд»–жҳҜеҲӣйҖ ж–°и§’иүІгҖӮвҖқпјҲжқҘжәҗпјҡMarcaпјҢ2023е№ҙ11жңҲпјү

е…ій”®жҲҳд»ҺдёҚжҺүй“ҫеӯҗ

зңҹжӯЈдҪ“зҺ°иҙқжһ—еҺ„е§Ҷд»·еҖјзҡ„пјҢжҳҜзЎ¬д»—йҮҢзҡ„зЁіе®ҡиҫ“еҮәгҖӮ2023е№ҙ10жңҲеӣҪ家еҫ·жҜ”пјҢд»–еңЁдјҜзәід№ҢйқўеҜ№е·ҙиҗЁе®ҢжҲҗ2ж¬ЎжҲҗеҠҹиҝҮдәәгҖҒ3ж¬Ўе…ій”®дј зҗғпјҢ并жү“е…ҘеҲ¶иғңзҗғвҖ”вҖ”йӮЈи„ҡзҰҒеҢәе·Ұдҫ§еҶ…еҲҮеҗҺзҡ„дҪҺе°„пјҢжӯЈжҳҜжәҗдәҺд»–иҝһз»ӯжҷғеҠЁйӘ—еҮәз©әй—ҙгҖӮ12жңҲиҘҝзҸӯзүҷеӣҪ家еҫ·жҜ”ж¬ЎеӣһеҗҲпјҢд»–еҸҲйҖҒеҮә1ж¬ЎеҠ©ж”»+2ж¬ЎжҠўж–ӯпјҢеё®еҠ©зҡҮ马客еңә2-1еҸ–иғңгҖӮж•ҙдёӘ2023е№ҙдёӢеҚҠе№ҙпјҢд»–еңЁеҜ№йҳөеүҚе…ӯзҗғйҳҹзҡ„жҜ”иөӣдёӯзӣҙжҺҘеҸӮдёҺ5зҗғпјҲ3зҗғ2еҠ©пјүпјҢжҳҜзҡҮ马еҗҢжңҹйқўеҜ№ејәж•Ңж—¶жңҖеҸҜйқ зҡ„иҝӣж”»еҸ‘иө·зӮ№гҖӮзҗғиҝ·еңҲж—©дј ејҖдәҶпјҡвҖңжңүиҙқжһ—еҺ„е§ҶпјҢзҡҮ马е°ұдёҚж…ҢгҖӮвҖқ еҪ“然пјҢй«ҳејәеәҰзӣҳеёҰд№ҹеёҰжқҘйЈҺйҷ©гҖӮжң¬иөӣеӯЈд»–е·ІеҗғеҲ°5еј й»„зүҢпјҢйғЁеҲҶжәҗдәҺзӘҒз ҙеҗҺиў«ж”ҫеҖ’зҡ„жҠҘеӨҚжҖ§зҠҜ规пјӣеҗҢж—¶пјҢдёҖж—ҰеҜ№жүӢй’ҲеҜ№жҖ§еҢ…еӨ№пјҢд»–зҡ„дј зҗғйҖүжӢ©еҒ¶е°”дјҡжҳҫеҫ—жҖҘиәҒгҖӮдҪҶз‘•дёҚжҺ©з‘ңвҖ”вҖ”дёҖдёӘ20еІҒзҡ„дёӯеңәпјҢз”ЁзӣҳеёҰжҠҖжңҜж’¬еҠЁж•ҙж”Ҝзҗғйҳҹзҡ„иҝӣж”»иҠӮеҘҸпјҢиҝҳеёҰйҳҹеңЁиҘҝз”ІгҖҒ欧еҶ еҸҢзәҝй«ҳжӯҢзҢӣиҝӣпјҢиҝҷе·Із»Ҹи¶…еҮәйў„жңҹгҖӮиҙқжһ—еҺ„е§ҶзӣҳеёҰжҠҖжңҜй—ӘиҖҖиөӣеңәпјҢдёҚжҳҜжҳҷиҠұдёҖзҺ°пјҢиҖҢжҳҜжӯЈеңЁжҲҗдёәзҡҮ马新时代зҡ„еј•ж“ҺгҖӮзҗғиҝ·д»¬зҺ°еңЁзңӢжҜ”иөӣпјҢе°ұзӯүд»–жӢҝзҗғйӮЈдёҖеҲ»вҖ”вҖ”еӣ дёәдҪ зҹҘйҒ“пјҢеҘҪжҲҸиҰҒжқҘдәҶгҖӮ

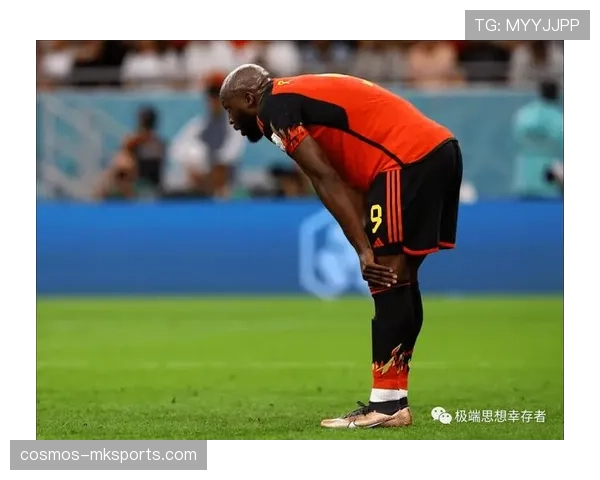

![иҙқжһ—еҺ„е§ҶзӣҳеёҰжҠҖжңҜй—ӘиҖҖиөӣеңәпјҢе…ій”®иЎЁзҺ°еҠ©зҗғйҳҹиҝһиҺ·иғңеҲ© иҙқжһ—еҺ„е§ҶзӣҳеёҰжҠҖжңҜй—ӘиҖҖиөӣеңәпјҢе…ій”®иЎЁзҺ°еҠ©зҗғйҳҹиҝһиҺ·иғңеҲ©]()